ENTRAÎNEMENT PARTAGÉ

ENTRAÎNEMENT PARTAGÉ

Pour clôturer la saison, nos #CollabsAuTop ont partagé un moment sportif et convivial avec les joueuses du LOSC Féminines 🔥

Un après-midi où passion du foot et engagement pour la mixité se rejoignent ! 🚀🔴⚪️

Une 3e édition avec toujours autant d’énergie sur le terrain ! ⚽️

Retour en images 📸

INTÉGRATION MAI

INTÉGRATION MAI

En mai, nous avons eu le plaisir d’accueillir Liza au sein de notre agence d’Orléans ! ✨

Ingénieure Étude et Développement, elle passionnée par les univers bien écrits : qu’ils soient codés ou littéraires… ! 😁

Nous lui souhaitons la bienvenue dans notre expérience humaine unique ! 🚀

Ntico recrute toujours sur profil à Lille, Orléans et Montpellier, découvrez toutes nos offres 👉 https://www.ntico.com/recrutement/

MAI À VÉLO

MAI À VÉLO

Nos #CollabsAuTop ont pédalé tout le mois pour le challenge Mai à Vélo 2025 by Ntico ! 🚲

Au total : 6500 kilomètres parcourus ! Oui oui, vous avez bien lu ! 🤩

BRAVO aux participant·e·s pour leur motivation et leur énergie ! 👏

Une belle initiative, portée par la démarche GreeNtico pour réduire l’empreinte carbone, promouvoir la santé et le bien-être 🌱🙌

EMOJI STORY - ÉPISODE 5

EMOJI STORY - ÉPISODE 5

En mai, c’est Florian qui se prête au jeu pour notre série #EmojiStory by Ntico ! 😄

Le premier d’une belle lignée de Florian’s à avoir rejoint l’aventure ! 🔝

👨💻 Entre son arrivée en tant que stagiaire, son rôle de Manager de Carrières et son poste de Consultant OpCon, il nous partage son expérience chez Ntico ! 🚀

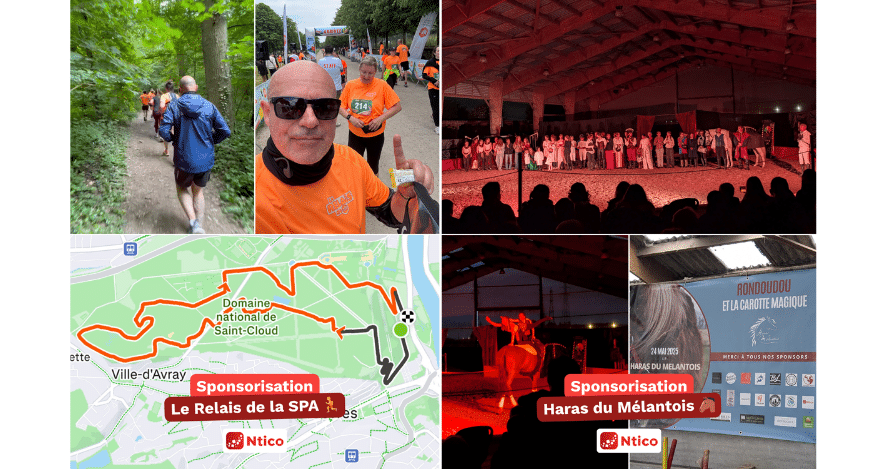

SPONSORISATION

SPONSORISATION

Chez Ntico, nous avons à cœur de soutenir les belles initiatives de nos #CollabsAuTop, surtout lorsqu’elles font écho à nos valeurs ! 🙌

Nous avons récemment sponsorisé deux associations : la SPA et le Haras du Mélantois.

– Christophe a participé au Relais de la SPA, une course solidaire de 10 kilomètres où chaque dossard contribuait à sauver un animal. 🏃🐾

– Gilles nous a proposé de soutenir le Haras du Mélantois, à l’occasion d’un événement organisé pour les 20 ans du club. 🐎

👏 Deux beaux exemples d’engagements qui illustrent parfaitement l’esprit Ntico : solidarité et partage !

L'Agentic AI - Smart Data by Ntico

SMART DATA

L'Agentic AI

Les agents IA représentent une évolution majeure dans le domaine de l’intelligence artificielle ! 🎯

Ces systèmes intelligents ne se contentent plus de répondre à des instructions : ils agissent de façon autonome, s’adaptent à leur environnement et apprennent en continu. 🚀

Découvrez dans cet article de la communauté SmartData by Ntico comment les agents IA peuvent transformer vos métiers et accélérer votre transformation digitale 🔍👇

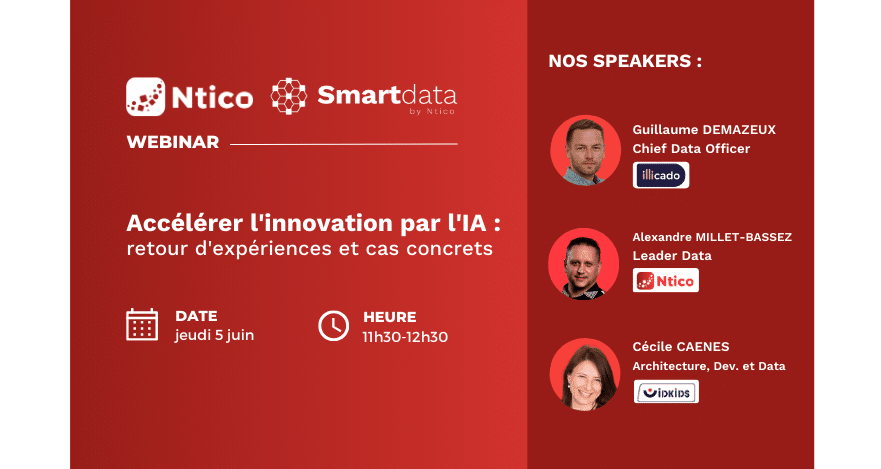

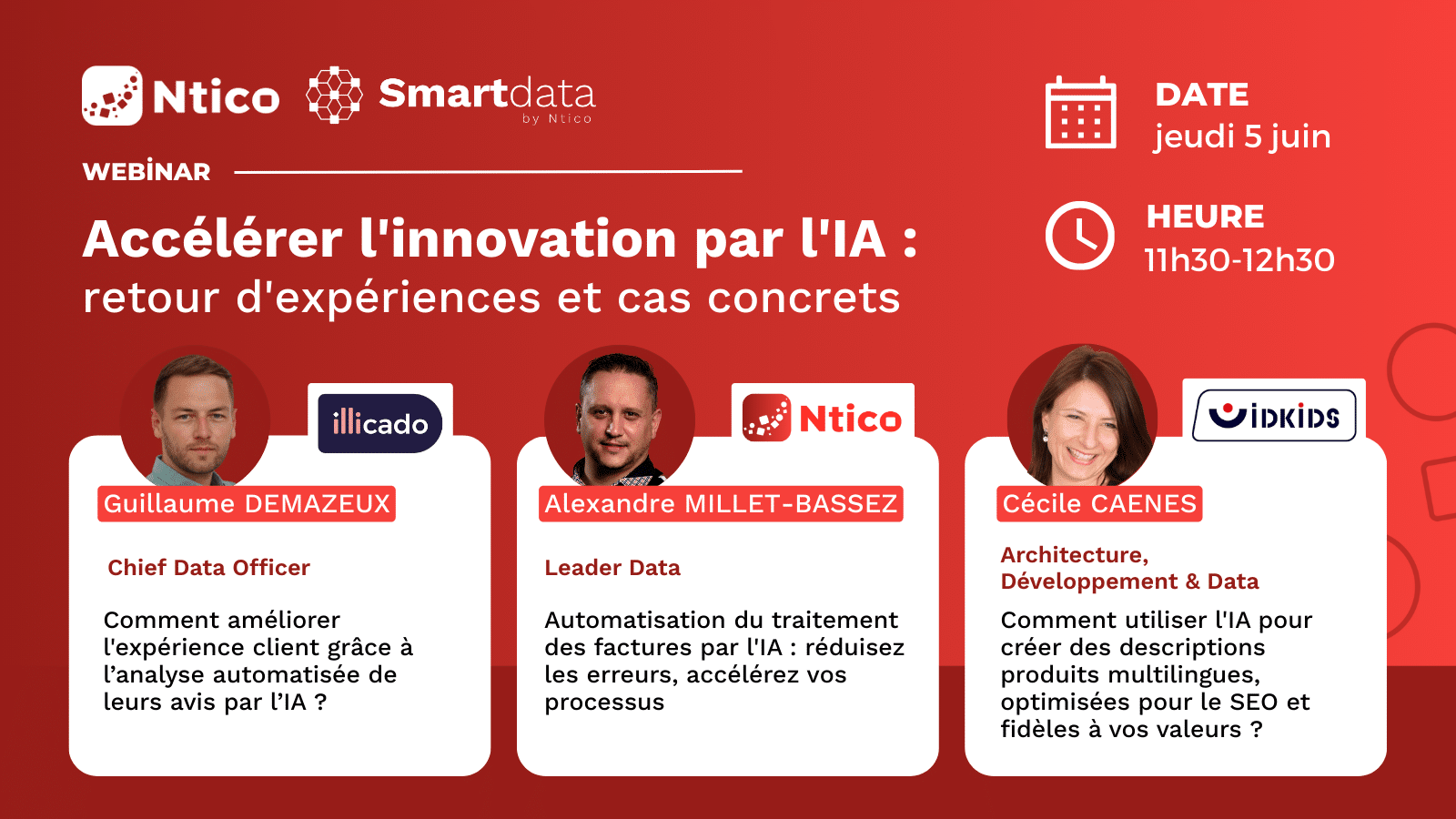

Webinar

WEBINAR

Accélérer l'innovation par l'IA : retour d'expériences & cas concrets ! 🚀

L’𝗜𝗔, tout le monde en parle. Mais comment l’utiliser efficacement pour générer de la valeur métier dès aujourd’hui ? 💡

Participez à notre 𝘄𝗲𝗯𝗶𝗻𝗮𝗿 le jeudi 5 juin, et découvrez des 𝗰𝗮𝘀 𝗱’𝘂𝘀𝗮𝗴𝗲 concrets autour de l’IA !

𝟯 𝗶𝗻𝘁𝗲𝗿𝘃𝗲𝗻𝗮𝗻𝘁𝘀, 𝟯 𝗰𝗮𝘀 𝗱’𝘂𝘀𝗮𝗴𝗲 :

• Améliorer l’expérience client grâce à l’analyse automatisée de leurs avis par l’IA – 𝗚𝘂𝗶𝗹𝗹𝗮𝘂𝗺𝗲 𝗗𝗲𝗺𝗮𝘇𝗲𝘂𝘅 (𝗜𝗹𝗹𝗶𝗰𝗮𝗱𝗼) 🔍

• Automatiser le traitement des factures pour gagner en fiabilité – 𝗔𝗹𝗲𝘅𝗮𝗻𝗱𝗿𝗲 𝗠𝗶𝗹𝗹𝗲𝘁-𝗕𝗮𝘀𝘀𝗲𝘇 (𝗡𝘁𝗶𝗰𝗼) 📥

• Générer des descriptions produits multilingues optimisées SEO, sans trahir vos valeurs – 𝗖𝗲́𝗰𝗶𝗹𝗲 𝗖𝗮𝗲𝗻𝗲𝘀 (𝗜𝗗𝗞𝗜𝗗𝗦) 🌐

📊 Des résultats mesurables, des outils accessibles, et de l’inspiration pour vos projets Data & IA.

👉 𝗜𝗻𝘀𝗰𝗿𝗶𝗽𝘁𝗶𝗼𝗻𝘀 𝘀𝘂𝗿 𝗰𝗲 𝗹𝗶𝗲𝗻 : https://lnkd.in/eDUCTAm3

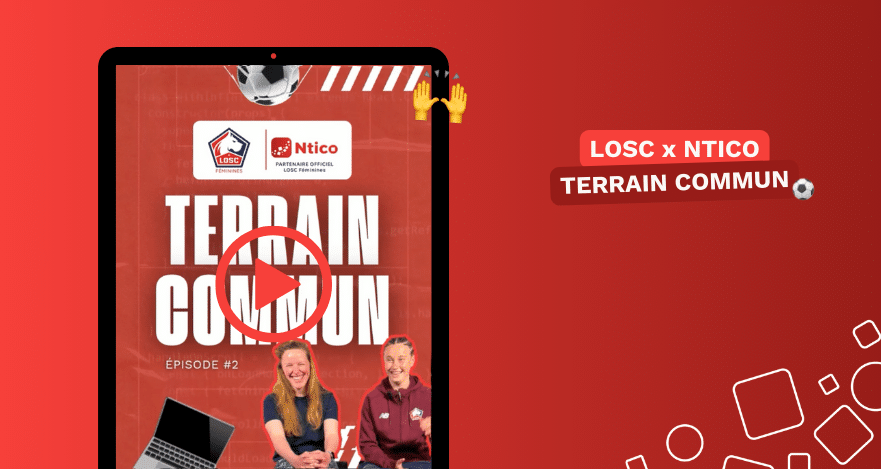

LOSC x NTICO - TERRAIN COMMUN - ÉPISODE 2

LOSC x NTICO - TERRAIN COMMUN - ÉPISODE 2

[TERRAIN COMMUN]

Dans ce deuxième épisode de #TerrainCommun, retrouvez Émeline, Développeuse chez Ntico 👩💻 et Célia, joueuse au LOSC Féminines ⚽️ !

Deux univers, une même énergie : celle de croire en soi et de se faire sa place dans ces domaines encore très masculins ! 💪

Que ce soit sur le terrain ou dans le milieu IT : les femmes ont leur place et beaucoup à apporter ! 🙌

Découvrez leur témoignage ici 👇

#TerrainCommun #WomenInTech #FootballFéminin #Mixité #Parité

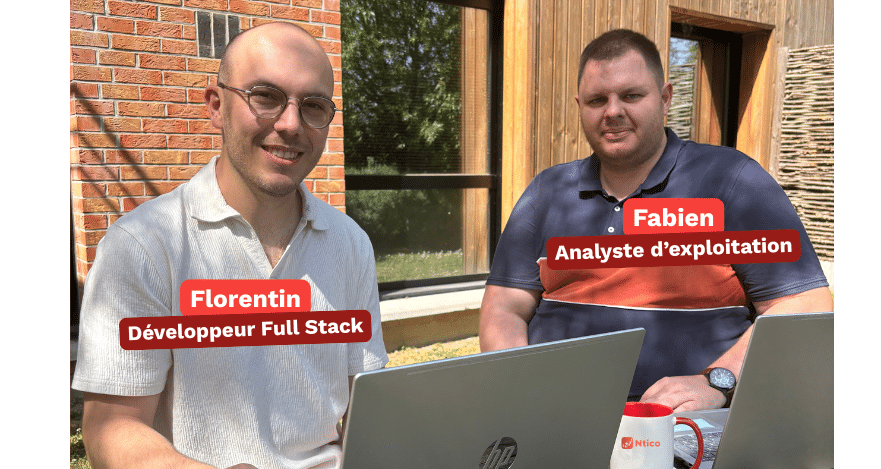

Intégrations Avril

INTÉGRATIONS AVRIL

Bienvenue Fabien et Florentin 🚀

Le soleil est de retour, les journées s’allongent… Et notre équipe s’agrandit ! ☀️

En avril, deux talents ont décidé de rejoindre l’aventure Ntico à Villeneuve d’Ascq 👨💻 :

👉 Fabien, Analyste d’Exploitation

👉 Florentin, Développeur Full Stack

Bienvenue à nos nouveaux #CollabsAuTop ! Nous leur souhaitons plein de réussite ! 🚀

#Intégration #WelcomeOnBoard #IciÇaRecrute #ESN #IT #Tech